فکر کن یه تکنولوژی داشته باشی که بتونه مثل یه مغز فوق هوشمند، نه تنها متنهای پیچیده رو درک کنه، بلکه داستان بنویسه، کد تولید کنه و حتی زبانها رو ترجمه کنه! تو سالهای اخیر، هوش مصنوعی و بهویژه مدلهای زبانی بزرگ (LLMs) از آزمایشگاههای تحقیقاتی به زندگی روزمره ما راه پیدا کردن. از چتباتهای باهوش گرفته تا ابزارهایی که محتوای خلاقانه تولید میکنن، این مدلها دارن دنیای دیجیتال رو زیر و رو میکنن. اما پشت این همه جادو، یه معماری انقلابی به اسم ترنسفورمر نهفتهست که انگار موتور یه ماشین پرسرعته!

در این یادداشت

- ترنسفورمر چیه؟ داستان یه انقلاب فنی

- قلب تپنده ترنسفورمر: چطور کار میکنه؟

- خود-توجهی (Self-Attention): مغز متفکر ترنسفورمر

- توجه چندسر: نگاه از زوایای مختلف

- رمزگذاری موقعیتی: ترتیب رو یادت نره!

- رمزگذار و رمزگشا: پایه های مهم در ترنسفورمر

- GPT و ترنسفورمر: یه ترکیب طلایی و بینظیر

- کاربردهای ترنسفورمر: از متن تا دنیای واقعی

- تولید متن: خلاقیت بدون مرز

- ترجمه ماشینی: زبانها بدون مرز

- خلاصهسازی و پاسخ به سؤال

- چتباتها و دستیارهای مجازی

- در آینده قراره از ترنسفورمرها چه چیزای دیگه ای ببینیم؟

- کلام پایانی من

ترنسفورمرها قلب تپنده مدلهایی مثل GPT هستن و آینده هوش مصنوعی رو شکل میدن. اگه برنامهنویس، توسعهدهنده وب یا حتی فقط یه علاقهمند به تکنولوژی هستی، شناخت این معماری میتونه دیدت رو به دنیای هوش مصنوعی عوض کنه. تو این مقاله قراره با زبانی ساده و دقیق، پرده از رازهای ترنسفورمر برداریم، بگیم چطور کار میکنه و چرا برای هر کسی که تو حوزه تکنولوژی فعاله، یه دانش ضروریه. آمادهای که یه سفر هیجانانگیز به قلب هوش مصنوعی داشته باشیم؟ بریم که شروع کنیم!

ترنسفورمر چیه؟ داستان یه انقلاب فنی

شاید برات جالب باشه که بدونی داستان ترنسفورمر از یه مقاله علمی تو سال 2017 شروع شد. تیمی از محققای گوگل یه مقاله با عنوان “توجه همهچیز شماست” (Attention Is All You Need) منتشر کردن که مثل یه بمب تو دنیای هوش مصنوعی صدا کرد. این مقاله یه معماری کاملاً جدید به اسم ترنسفورمر معرفی کرد که دیگه خبری از مدلهای قدیمی و کند مثل شبکههای بازگشتی (RNN) یا LSTM توش نبود.

قبل از ترنسفورمر، مدلهای زبانی دادهها رو کلمه به کلمه پردازش میکردن، انگار که داری یه کتاب رو خط به خط میخونی. این روش نه تنها کند بود، بلکه نمیتونست روابط پیچیده بین کلمات تو یه متن بلند رو خوب درک کنه. ترنسفورمر این مشکل رو با یه ایده باحال حل کرد: مکانیزم توجه (Attention). این مکانیزم به مدل اجازه میده به جای پردازش خطی، همه کلمات یه جمله رو همزمان بررسی کنه و بفهمه کدوم کلمه به کدوم یکی دیگه ربط داره.

این نوآوری باعث شد ترنسفورمرها هم سریعتر باشن و هم بتونن متون پیچیدهتر رو بهتر درک کنن. نتیجه؟ مدلهایی مثل GPT که حالا میتونن متنهای انسانگونه تولید کنن، ترجمههای دقیق انجام بدن و حتی کد بنویسن! برای ما که دنبال ابزارهای قدرتمند و بهروز هستیم، شناخت ترنسفورمرها مثل اینه که کلید یه گنج تکنولوژیک رو پیدا کنیم.

قلب تپنده ترنسفورمر: چطور کار میکنه؟

برای اینکه حسابی با ترنسفورمر آشنا بشیم، بذارید طبق معمول مثل یه برنامه نویس بهش نگاه کنیم. تصور کن ترنسفورمر یه تابع هوشمنده که دادههای خام (مثل یه جمله) رو میگیره و یه خروجی هوشمند تحویل میده. اما این تابع چطور کار میکنه؟ بیاید تا جایی که بشه سعی کنیم ساده توضیح بدیم و اجزای اصلی رو یکییکی شرح بدیم.

خود-توجهی (Self-Attention): مغز متفکر ترنسفورمر

هسته اصلی ترنسفورمر، مکانیزم خود-توجهی هستش. فکر کن داری یه متن میخونی و باید بفهمی هر کلمه چه ربطی به بقیه داره. خود-توجهی به مدل اجازه میده هر کلمه تو یه جمله رو با همه کلمات دیگه مقایسه کنه و بفهمه کدومشون برای درک معنی مهمترن. مثلاً تو جمله “بانک کنار رودخانه سود وامها رو اعلام کرد”، خود-توجهی میفهمه که “بانک” به “سود وامها” ربط داره و نه فقط به “رودخانه”.

این کار با تبدیل هر کلمه به سه بردار انجام میشه: پرسوجو (Query)، کلید (Key) و مقدار (Value). پرسوجو مثل یه سؤاله که میپرسه این کلمه به چی ربط داره. کلیدها مثل برچسبهای بقیه کلماتن و مقدارها اطلاعات واقعیشون رو نگه میدارن. مدل شباهت بین پرسوجو و کلیدها رو محاسبه میکنه (مثل یه ضرب داخلی) و وزنهایی تولید میکنه که نشون میده هر کلمه چقدر مهمه. بعد این وزنها رو به مقدارها اعمال میکنه تا یه نمایش عمیق از کلمه بسازه.

توجه چندسر: نگاه از زوایای مختلف

برای اینکه مدل همهچیز رو بهتر ببینه، از توجه چندسر (Multi-Head Attention) استفاده میکنه. این مثل اینه که چندتا عینک با لنزهای مختلف داشته باشی. هر “سر توجه” به یه جنبه خاص از متن نگاه میکنه، مثلاً یکی به معنی کلمات و یکی به ساختار جمله. خروجی این سرها با هم ترکیب میشه تا مدل یه درک کاملتر از متن پیدا کنه.

رمزگذاری موقعیتی: ترتیب رو یادت نره!

چون ترنسفورمر همه کلمات رو همزمان پردازش میکنه، خودش نمیدونه کدوم کلمه اول اومده و کدوم دوم. برای همین از رمزگذاری موقعیتی (Positional Encoding) استفاده میکنه. این مثل اضافه کردن یه برچسب به هر کلمهست که میگه جای این کلمه تو جمله کجاست. معمولاً این کار با توابع سینوسی انجام میشه تا مدل بتونه فاصله بین کلمات رو هم بفهمه.

رمزگذار و رمزگشا: پایه های مهم در ترنسفورمر

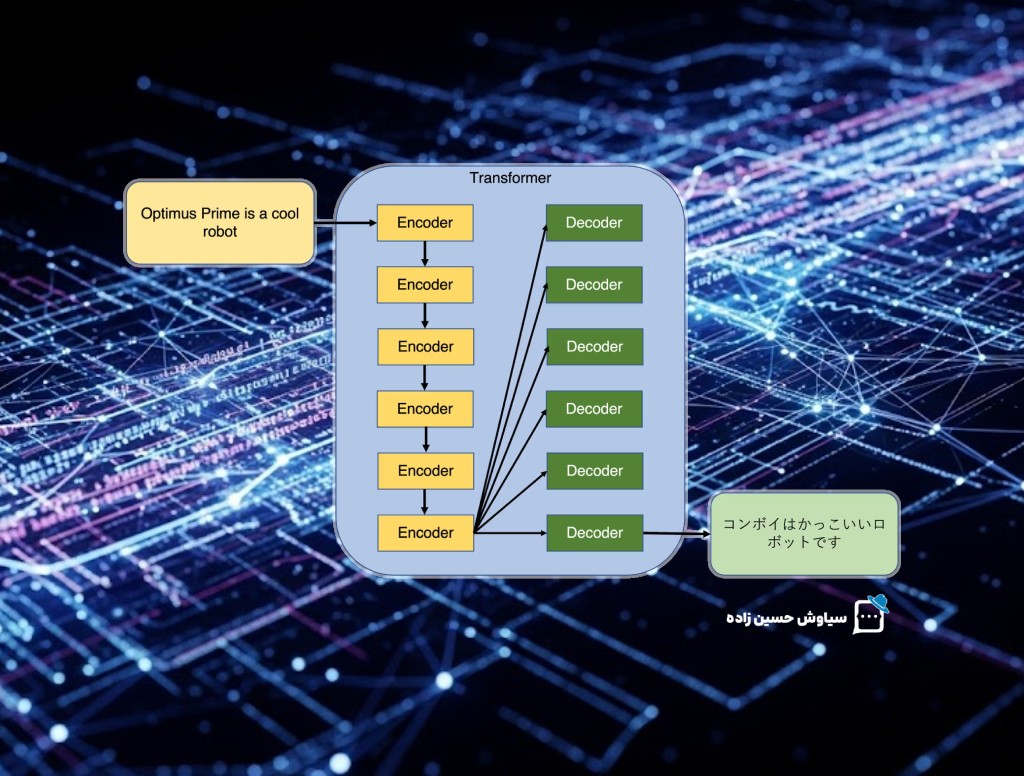

ترنسفورمر از دو بخش اصلی تشکیل شده: رمزگذار (Encoder) و رمزگشا (Decoder). رمزگذار متن ورودی رو میگیره و یه نمایش عمیق (که قبلا گفتیم) ازش میسازه. هر لایه رمزگذار شامل خود-توجهی و یه شبکه عصبی پیشخوره. رمزگشا هم این نمایش رو میگیره و خروجی (مثل یه جمله ترجمهشده) رو کلمه به کلمه تولید میکنه. رمزگشا یه لایه توجه اضافه داره که به خروجی رمزگذار نگاه میکنه تا مطمئن بشه خروجی با ورودی هماهنگه.

برای نمونه، یه تکه کد JSON ساده که ساختار یه لایه ترنسفورمر رو نشون میده:

{

"layer": {

"self_attention": {

"query": "vector",

"key": "vector",

"value": "vector",

"heads": 8

},

"feed_forward": {

"units": 512,

"activation": "relu"

},

"positional_encoding": "sinusoidal"

}

}

این کد نشون میده یه لایه ترنسفورمر چطور خود-توجهی، شبکه پیشخور و رمزگذاری موقعیتی رو کنار هم میذاره. برای ما ایرانیها که ممکنه بخوایم از این مدلها تو پروژههای لوکالمون استفاده کنیم، این انعطافپذیری خیلی ارزشمنده.

GPT و ترنسفورمر: یه ترکیب طلایی و بینظیر

حالا که با ترنسفورمر آشنا شدیم، بذارید ببینیم GPT چطور ازش استفاده میکنه. GPT (مخفف Generative Pre-trained Transformer) یه مدل زبانیه که فقط از بخش رمزگشای ترنسفورمر استفاده میکنه. این مدل برای تولید متنهای انسانگونه طراحی شده، انگار که یه نویسنده باهوش همیشه همراهته!

GPT با پیشبینی کلمه بعدی تو یه توالی کار میکنه. مثلاً اگه بهش بگی “داستان یه روز بارونی تو تهران”، کلمه به کلمه یه داستان میسازه که انگار خودت نوشتیش. این کار با لایههای رمزگشای ترنسفورمر انجام میشه که از خود-توجهی پوششدار (Masked Self-Attention) استفاده میکنن. این یعنی مدل فقط به کلمات قبلی نگاه میکنه و نمیتونه آینده رو “تقلب” کنه!

آموزش GPT دو مرحله داره: پیشآموزش و تنظیم دقیق. تو پیشآموزش، مدل روی یه عالمه متن (مثل کتابها، مقالات و وبسایتها) یاد میگیره که چطور زبان رو بفهمه. بعد تو تنظیم دقیق، برای کارای خاص مثل پاسخ به سؤال یا نوشتن شعر فارسی بهینه میشه. این انعطافپذیری باعث شده GPT برای هر چیزی از نوشتن مقاله گرفته تا کدنویسی کاربرد داشته باشه.

برای ما ایرانیها که دنبال ابزارهای خلاقیم، GPT میتونه مثل یه دستیار همهکاره عمل کنه. مثلاً میتونی ازش بخوای یه پست وبلاگ فارسی بنویسه یا حتی یه کد ساده برای یه پروژه بنویسه. توی یوتیوب هم میبینیم که خیلیا دارن از مدلهای مشابه برای پروژههاشون استفاده میکنن.

کاربردهای ترنسفورمر: از متن تا دنیای واقعی

ترنسفورمرها فقط یه مفهوم تئوری نیستن؛ این معماری داره دنیای واقعی رو تغییر میده. بیاید چندتا از کاربردهای باحالش رو ببینیم:

تولید متن: خلاقیت بدون مرز

مدلهای مبتنی بر ترنسفورمر مثل GPT میتونن هر چیزی از داستان و شعر گرفته تا کد و مقاله بنویسن. مثلاً میتونی ازش بخوای یه داستان کوتاه درباره یه سفر ماجراجویانه تو کویر لوت بنویسه، و نتیجه یه متن خوشساخت و جذابه. این برای نویسندهها، تولیدکنندههای محتوا و حتی برنامهنویسهایی که دنبال اسکریپتهای سریع هستن، عالیه.

ترجمه ماشینی: زبانها بدون مرز

ترنسفورمرها ترجمه ماشینی رو به یه دنیای جدید بردن. حالا میتونی یه متن فارسی رو به انگلیسی یا عربی ترجمه کنی و نتیجهای بگیری که انگار یه مترجم حرفهای روش کار کرده نه یک متن عادی خروجی از مترجم گوگل. این برای کسبوکارهایی که میخوان بینالمللی بشن، یه ابزار فوقالعادهست.

خلاصهسازی و پاسخ به سؤال

اگه یه مقاله بلند داری و وقت خوندنش نیست، ترنسفورمرها میتونن خلاصهاش کنن یا به سؤالاتت دربارهش جواب بدن. مثلاً فرض کن یه گزارش 50 صفحهای درباره بازار ارز دیجیتال داری. یه مدل ترنسفورمر میتونه نکات کلیدی رو تو چند خط برات جمع کنه.

چتباتها و دستیارهای مجازی

چتباتهای امروزی که تو تلگرام یا وبسایتها میبینی، بیشترشون از ترنسفورمرها قدرت میگیرن. اینا میتونن با مشتریها حرف بزنن، سؤالاتشون رو جواب بدن و حتی یه کم شوخی کنن! (البته ممکنه خرابکاری هم بکنن) برای استارتاپهای ایرانی که دنبال پشتیبانی مشتری با هزینه کمن، این یه راهحل عالیه اگر حواستون بهش باشه.

این کاربردها فقط یه گوشه از تواناییهای ترنسفورمرها هستن. چون این معماری انعطافپذیره، میتونه تو هر حوزهای از تحلیل داده گرفته تا خلاقیتهای هنری استفاده بشه. برای ماها که همیشه دنبال راههای نوآورانه هستیم، ترنسفورمرها مثل یه معدن طلای تکنولوژیکن!

در آینده قراره از ترنسفورمرها چه چیزای دیگه ای ببینیم؟

ترنسفورمرها هنوز تو اول راهن و هر روز دارن بهتر میشن. محققها دارن رو نسخههای سبکتر و سریعتر کار میکنن که بتونن روی دستگاههای سادهتر مثل گوشیهای هوشمند اجرا بشن. این یعنی تو آینده نزدیک، ممکنه یه اپلیکیشن رو گوشیت داشته باشی که به اندازه GPT-4 باهوشه! یه روند دیگه، مدلهای مالتی مدیاس. این مدلها میتونن همزمان متن، تصویر و حتی صدا رو پردازش کنن. مثلاً تصور کن یه مدل که بتونه یه عکس از یه منظره رو ببینه و یه شعر فارسی دربارهش بنویسه! این برای برنامهنویسها و استارتاپهای حرفه ای که دنبال نوآوریان، یه فرصت بزرگه.

یه چالش بزرگ هم مصرف انرژی این مدلهاست. ترنسفورمرها برای آموزش به قدرت محاسباتی زیادی نیاز دارن، ولی محققها دارن روشهای جدیدی برای کم کردن این هزینهها پیدا میکنن. یه روزی ممکنه بتونی یه مدل ترنسفورمر رو روی لپتاپت اجرا کنی بدون اینکه برق زیادی مصرف بشه!

کلام پایانی من

ترنسفورمرها فقط یه تکنولوژی نیستن؛ اونا یه انقلاب فناورین که دارن نحوه تعامل ما با اطلاعات رو عوض میکنن. از تولید متنهای خلاقانه گرفته تا ترجمه و چتباتها، این معماری قلب تپنده همین هوش مصنوعی امروزیه. برای هر کسی که تو دنیای تکنولوژی کار میکنه، از برنامهنویسها گرفته تا صاحبای استارتاپ، شناخت ترنسفورمرها مثل یاد گرفتن یه زبان جدیده: یه در به یه دنیای پر از فرصت باز میکنه. اگه میخوای تو این حوزه پیشرو باشی، الان وقتشه که دست به کار بشی. با مدلهای ساده شروع کن و ببین چطور میتونی ترنسفورمرها رو تو پروژههات استفاده کنی. و اما به رسم همیشگی آقااا ببخشید ما دوره نفروختیم این چیزا رو بگیم 😁

فریدون حسینی

ژوئن 3, 2025بنفشه مرادی

سپتامبر 27, 2025حسنا دلاوری

سپتامبر 30, 2025